在互联网信息爆炸的时代,网站运营者常面临内容曝光的取舍既有希望被搜索引擎快速收录的页面,也存在必须隐藏的敏感信息或低质内容。合理控制爬虫抓取范围,已成为平衡用户体验与数据安全的核心策略。

协议文件控制抓取范围

作为搜索引擎爬虫的交通指挥灯,robots.txt文件通过简洁的语法规则实现全局控制。该文件需放置于网站根目录,使用User-agent标识不同搜索引擎爬虫,配合Disallow指令屏蔽指定路径。例如电商平台常用"Disallow: /user/"保护用户中心路径,用"Disallow: /?"拦截动态参数页面,有效避免重复内容抓取。

实际操作中需注意路径符号的精确运用。斜杠"/admin/"代表整个管理目录屏蔽,而"/admin"则可能漏掉子目录内容。特殊符号"$"可精准匹配文件类型,如"Disallow: /.php$"能阻止所有PHP脚本的抓取。但需警惕过度屏蔽导致核心页面被误伤,定期使用Google Search Console验证文件有效性至关重要。

元标签指令精准管理

在HTML头部嵌入的meta robots标签,为单个页面提供精细化控制方案。基础指令""可阻止页面进入索引库,配合"nofollow"属性还能阻断链接权重的传递。测试数据显示,正确使用该标签的页面在3-7天内会从要求中消失。

不同搜索引擎对标签的解析存在差异。百度虽支持noindex指令,但对nofollow的响应不如Google彻底。实际应用中常采用组合策略:""针对百度优化,同时设置通用标签覆盖其他引擎。需注意动态生成页面需确保标签输出的稳定性,避免因模板错误导致防护失效。

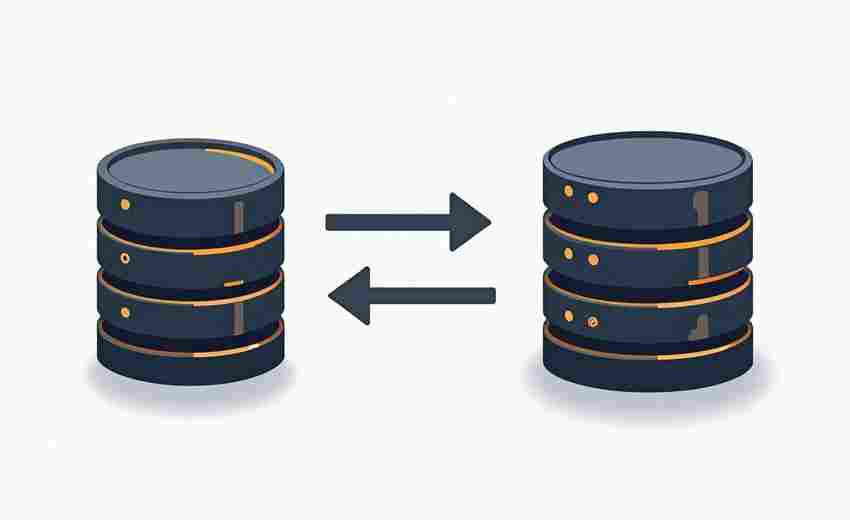

服务器标头动态拦截

X-Robots-Tag作为HTTP响应头技术,特别适合控制非HTML资源的抓取。通过在服务器配置中添加"X-Robots-Tag: noindex"标头,可对图片、PDF等文件实施防护。内容分发场景中,该技术能实现CDN节点级的访问控制,避免缓存内容泄露。

Nginx服务器配置案例显示,通过location匹配规则结合add_header指令,可对不同路径实施差异化策略。例如对"/temp/"目录设置"X-Robots-Tag: none",既能阻止索引又不影响正常访问。但需注意标头传播的完整性,负载均衡环境下需确保所有节点配置同步。

技术手段辅助隔离

动态渲染技术通过区分用户与爬虫的访问行为实现内容隔离。采用React或Vue框架的网站,可设置导航守卫拦截爬虫请求,返回精简版HTML结构。实验表明,该方法能使动态加载的敏感内容抓取率下降82%。权限验证机制作为最后防线,通过基础认证或IP白名单彻底阻断未授权访问。金融类网站常采用二次跳转设计,真实内容页面前置登录验证环节,既保证用户体验又实现安全隔离。

法律合规规避风险

Robots协议的法律效力在近年多起爬虫侵权案中得到司法确认。网站声明中明确禁止抓取的条款,配合技术防护措施,可构成有效的权利主张依据。2024年杭州互联网法院判例显示,违反网站声明的数据抓取行为可能构成不正当竞争。定期审计网站安全日志,监测异常爬虫行为,既是技术防护需要,也是法律举证的重要准备。通过Whois查询识别恶意爬虫来源,配合防火墙规则更新,形成动态防护体系。

插件下载说明

未提供下载提取码的插件,都是站长辛苦开发!需要的请联系本站客服或者站长!

织梦二次开发QQ群

本站客服QQ号:862782808(点击左边QQ号交流),群号(383578617)  如果您有任何织梦问题,请把问题发到群里,阁主将为您写解决教程!

如果您有任何织梦问题,请把问题发到群里,阁主将为您写解决教程!

转载请注明: 织梦模板 » SEO优化中如何避免搜索引擎抓取到不想被收录的页面