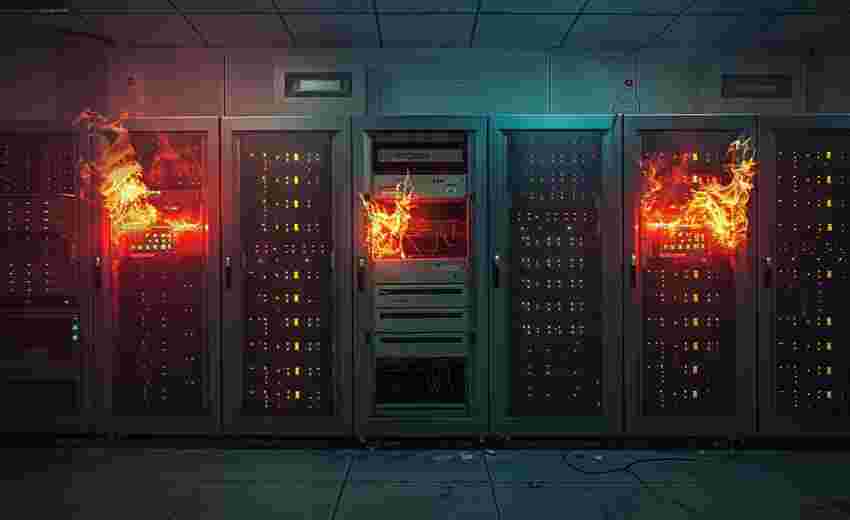

在互联网生态中,恶意爬虫如同一把双刃剑,既能被搜索引擎用于合法索引,也可能被攻击者滥用于数据窃取、服务器资源消耗及黑帽SEO欺诈。这类异常流量不仅威胁网站安全,还会干扰搜索引擎对网站质量的评估,导致合法内容排名下降。通过服务器防火墙的精准过滤与策略优化,既可屏蔽恶意爬虫对服务器的侵扰,又能提升搜索引擎友好度,形成安全与SEO效果的双重增益。

流量特征识别与拦截

恶意爬虫的核心特征体现在访问模式异常。以高频请求为例,普通用户访问频次具有随机性和间隔性,而恶意爬虫通常以固定时间间隔发起密集扫描,例如每秒数十次请求。服务器防火墙可通过实时监控IP地址的请求速率阈值,对超出正常范围的流量自动触发拦截机制。阿里云WAF的威胁情报库便集成了动态IP行为分析模型,能实时识别并阻断来自IDC机房IP、拨号池IP等高风险来源的爬虫流量。

User-Agent伪装是另一典型特征。部分恶意爬虫通过伪造“Googlebot”“BaiduSpider”等合法标识逃避检测。对此,防火墙需结合反向DNS验证机制,核验声明为搜索引擎的IP是否真实归属官方爬虫池。Cloudflare的AI审核功能通过比对机器人流量与robots.txt策略,可精准识别伪造蜘蛛行为,并联动WAF规则进行拦截。研究表明,约65%的恶意爬虫流量存在User-Agent篡改现象,此类特征已成为防火墙策略设计的核心参数。

动态防护策略配置

基于规则的静态拦截存在滞后性,因此动态策略调整成为关键。防火墙可通过机器学习模型分析历史攻击数据,例如爬虫常访问的敏感路径(如登录接口、API端点)、非常规HTTP方法(如HEAD请求占比异常)等行为模式。以路径防护为例,管理员可设置特定目录的访问权限,如限制“/admin”路径仅允许已验证用户访问,或对“/api”接口实施请求频率管控。这种细粒度规则既能避免误伤正常流量,又能切断爬虫的数据采集链条。

验证码挑战与JS校验则是动态防御的另一维度。当防火墙检测到可疑会话时,可插入滑块验证或动态Token,阻断自动化脚本的连续操作。阿里云WAF的“严格滑块”模式将验证通过率与IP信誉库关联,对多次失败的请求自动升级为阻断策略。实验数据显示,该方法可使恶意爬虫的渗透成功率下降72%,同时减少对正常用户的干扰。

SEO友好型错误处理

404页面的不当配置可能成为黑帽SEO的利用对象。恶意攻击者通过伪造大量失效链接诱导搜索引擎抓取,导致网站出现软404错误(返回200状态码但无有效内容)。防火墙需确保服务器对不存在页面严格返回硬404状态码,并将此类请求导入自定义404页面。例如,WordPress的Redirection插件可自动将无效URL重定向至预设错误页,该页面嵌入站内导航链接,既降低用户跳出率,又引导爬虫抓取有效内容。

自定义404页面的SEO价值不容忽视。研究表明,包含热门文章入口、分类标签的404模板可使用户停留时间增加40%,间接提升页面索引权重。防火墙可通过日志分析工具(如Google Search Console)识别爬虫频繁触发的404路径,修复断裂链接或设置301重定向,从而消除搜索引擎对网站结构的。

合规流量放行机制

过度拦截可能误伤合法爬虫,影响搜索引擎收录。防火墙需建立白名单机制,对已通过验证的搜索引擎IP(如Google官方公布的爬虫IP段)实施放行。Cloudflare的“合法爬虫规则”功能支持自动同步robots.txt策略,仅允许遵守协议的白名单爬虫访问指定路径。结合流量指纹技术(如TLS握手特征、TCP窗口大小)可进一步区分真实浏览器与自动化工具,避免传统User-Agent检测的局限性。

负载均衡与资源隔离也是优化方向。通过反向代理服务器将爬虫流量导向专用集群,可避免核心业务服务器资源被耗尽。阿里云WAF的CC安全防护模块即采用分层架构,对高频请求实施队列管理,确保合法爬虫在配额内正常抓取,而恶意流量被隔离至沙箱环境。该方法使电商类网站在大促期间的搜索引擎收录率提升了28%。

插件下载说明

未提供下载提取码的插件,都是站长辛苦开发!需要的请联系本站客服或者站长!

织梦二次开发QQ群

本站客服QQ号:862782808(点击左边QQ号交流),群号(383578617)  如果您有任何织梦问题,请把问题发到群里,阁主将为您写解决教程!

如果您有任何织梦问题,请把问题发到群里,阁主将为您写解决教程!

转载请注明: 织梦模板 » 服务器防火墙如何过滤恶意爬虫以优化SEO效果