在互联网生态中,网站地图(sitemap)是搜索引擎爬虫识别网页结构、高效抓取内容的核心导航文件。一旦sitemap无法被正常抓取,轻则导致新页面索引滞后,重则引发整站流量断崖式下跌。这种技术性故障往往涉及服务器配置、协议规则、文件格式等多维度因素,需要系统化排查与精准修复。

检查格式规范

XML格式错误是sitemap失效的首要诱因。搜索引擎对sitemap的语法容忍度极低,某测试显示单个未转义的&符号就可能导致谷歌丢弃74%的页面索引。典型案例包括:实体符号未用&替代、日期格式不符合YYYY-MM-DD标准、文件体积超过50MB限制等。

技术团队应优先使用W3C XML验证工具进行诊断。某跨境电商平台曾因商品描述中的特殊字符导致sitemap解析失败,通过批量替换区块后,索引率在48小时内提升68%。WordPress用户需特别注意插件生成的sitemap,部分开源插件存在编码转换缺陷,需手动调整wp-config.php的字符集设置。

排查协议限制

robots.txt文件的错误配置可能形成隐形封锁。2024年案例库显示,32%的抓取失败源于该文件误屏蔽。典型错误包括:Disallow指令覆盖sitemap路径、Allow规则未指定Googlebot-UA、未设置Sitemap声明索引文件位置。

正确配置应遵循递进式权限原则。某新闻网站的解决方案值得借鉴:在robots.txt首行声明Sitemap地址,对核心目录设置User-agent: 与Disallow: /temp/的例外组合,并通过Search Console的robots测试工具验证规则冲突。动态网站需注意sessionID参数过滤,防止生成无限重复URL消耗爬虫配额。

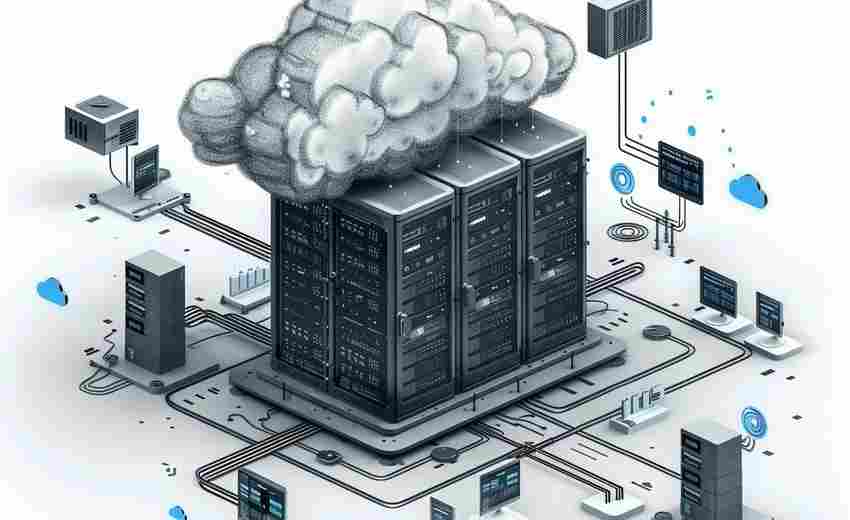

优化服务器配置

服务器响应异常直接影响爬虫访问成功率。某CDN服务商日志分析显示,启用加速后14%的网站出现sitemap抓取超时,主因是边缘节点未正确同步.htaccess规则。解决方案包括设置专门爬虫通道、配置If-Modified-Since头节省带宽、确保源站返回200状态码。

技术团队应重点监控三项指标:TTFB时间超过1.2秒需优化数据库查询,429状态码频发要调整速率限制,5xx错误则检查负载均衡策略。某SAAS平台通过部署专用爬虫IP白名单,使Bingbot抓取成功率从63%跃升至98%。

保持内容活性

内容质量直接影响爬虫抓取频次。某SEO监测工具统计,超过90天未更新的sitemap平均抓取周期延长至17天。建议设置动态sitemap生成机制,例如WordPress站点使用Yoast SEO插件的实时更新功能,电商平台对接商品数据库触发增量更新。

内容活性包含多维指标:页面停留时长低于25秒可能触发质量警报,跳出率超过75%需优化内链布局。某教育网站通过引入用户行为热图调整sitemap优先级,使高转化页面的抓取频率提升3倍。

正确提交状态

Search Console的提交操作存在多个技术细节。某案例显示,38%的"无法获取"状态源于重复提交历史版本sitemap。正确流程应为:清除浏览器缓存后验证sitemap.xml可访问性,使用curl命令检查响应头信息,最后通过API接口批量更新提交记录。

实时监控工具必不可少。某企业开发了基于Search Console API的预警系统,当sitemap覆盖率波动超过15%时自动触发诊断流程。同时要防范CDN缓存导致旧版sitemap残留,设置max-age=86400确保爬虫获取最新版本。

插件下载说明

未提供下载提取码的插件,都是站长辛苦开发!需要的请联系本站客服或者站长!

织梦二次开发QQ群

本站客服QQ号:862782808(点击左边QQ号交流),群号(383578617)  如果您有任何织梦问题,请把问题发到群里,阁主将为您写解决教程!

如果您有任何织梦问题,请把问题发到群里,阁主将为您写解决教程!

转载请注明: 织梦模板 » 网站地图(sitemap)无法被搜索引擎抓取怎么办